撰文:TanyaMalhotra

来源:Marktechpost

编译:DeFi之道

图片来源:由无界版图AI工具生成

随着生成性人工智能在过去几个月的巨大成功,大型语言模型正在不断改进。这些模型正在为一些值得注意的经济和社会转型做出贡献。OpenAI开发的ChatGPT是一个自然语言处理模型,允许用户生成有意义的文本。不仅如此,它还可以回答问题,总结长段落,编写代码和电子邮件等。其他语言模型,如Pathways语言模型、Chinchilla等,在模仿人类方面也有很好的表现。

Unchained Capital披露合作伙伴的电子邮件数据泄漏:金色财经报道,Unchained Capital 首席执行官 Joe Kelly 在周三发给客户的电子邮件和公司网站上发布的一封信中表示,今年早些时候,Unchained 使用的外部电子邮件营销提供商ActiveCampaign (AC) 上周遭到黑客攻击。与AC共享的信息,客户电子邮件地址、用户名、账户状态、客户是否拥有活跃的多重签名保险库或使用 Unchained Capital 的贷款以及可能的 IP 地址可能已经未经授权流出。Kelly表示,Unchained上任何系统都没有受到影响,这意味着从未与 AC 共享的客户资料信息没有泄露。Kelly补充说,虽然客户比特币保管受到多重签名冷存储的保护,但客户仍应了解发生的事情并警惕网络钓鱼攻击。\u2028(Coindesk)[2022/3/17 14:01:39]

大型语言模型使用强化学习来进行微调。强化学习是一种基于奖励系统的反馈驱动的机器学习方法。代理通过完成某些任务并观察这些行动的结果来学习在一个环境中的表现。代理在很好地完成一个任务后会得到积极的反馈,而完成地不好则会有相应的惩罚。像ChatGPT这样的LLM表现出的卓越性能都要归功于强化学习。

Kraken通过Chainlink节点将Oracle费率提供给DeFi:加密货币交易所Kraken今日宣布,它现在正在运行自己的Chainlink节点,使其能够向以太坊和其他区块链广播其Oracle费率,以便去中心化金融(DeFi)应用程序和开发者使用。Chainlink内置的加密签名功能也允许用户访问平台任何数据的链上证明。(Coindesk)[2021/2/1 18:37:57]

ChatGPT使用来自人类反馈的强化学习,通过最小化偏差对模型进行微调。但为什么不是监督学习呢?一个基本的强化学习范式由用于训练模型的标签组成。但是为什么这些标签不能直接用于监督学习方法呢?人工智能和机器学习研究员SebastianRaschka在他的推特上分享了一些原因,即为什么强化学习被用于微调而不是监督学习。

美国空军将使用Chainalysis区块链分析服务:9月3日消息,美国空军与区块链分析公司Chainalysis达成合作,将使用其区块链分析服务。美国空军将为其服务支付77.97万美元,美国空军两年前还与其签署了另外两份合同。目前,美国空军在Chainalysis的分析服务上总共花费了90万美元。(Decrypt)[2020/9/3]

区块链品牌营销机构ChainPlus.One获得极豆资本1200万元资金:Odaily获悉,区块链品牌营销机构ChainPlus.One今日宣布获得来自极豆资本的 1200万元首轮融资。资金将主要用于团队建设、海外市场拓展、国内媒体及社群建设。[2018/5/16]

不使用监督学习的第一个原因是,它只预测等级,不会产生连贯的反应;该模型只是学习给与训练集相似的反应打上高分,即使它们是不连贯的。另一方面,RLHF则被训练来估计产生反应的质量,而不仅仅是排名分数。

SebastianRaschka分享了使用监督学习将任务重新表述为一个受限的优化问题的想法。损失函数结合了输出文本损失和奖励分数项。这将使生成的响应和排名的质量更高。但这种方法只有在目标正确产生问题-答案对时才能成功。但是累积奖励对于实现用户和ChatGPT之间的连贯对话也是必要的,而监督学习无法提供这种奖励。

不选择SL的第三个原因是,它使用交叉熵来优化标记级的损失。虽然在文本段落的标记水平上,改变反应中的个别单词可能对整体损失只有很小的影响,但如果一个单词被否定,产生连贯性对话的复杂任务可能会完全改变上下文。因此,仅仅依靠SL是不够的,RLHF对于考虑整个对话的背景和连贯性是必要的。

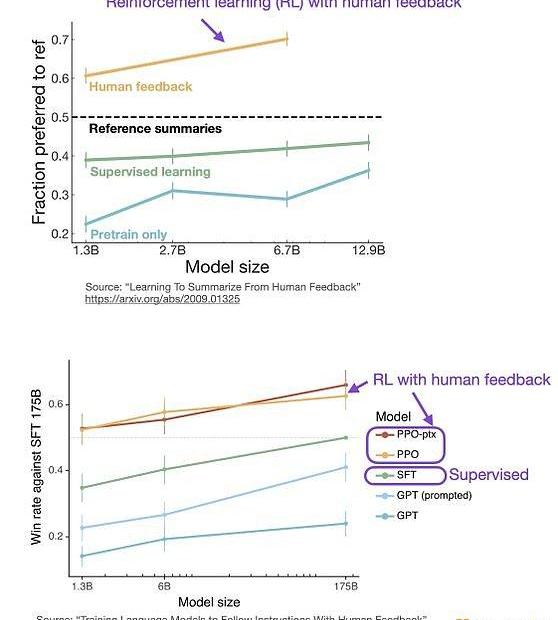

监督学习可以用来训练一个模型,但根据经验发现RLHF往往表现得更好。2022年的一篇论文《从人类反馈中学习总结》显示,RLHF比SL表现得更好。原因是RLHF考虑了连贯性对话的累积奖励,而SL由于其文本段落级的损失函数而未能很好做到这一点。

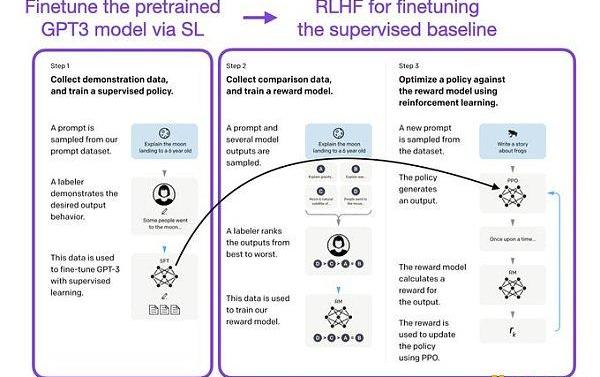

像InstructGPT和ChatGPT这样的LLMs同时使用监督学习和强化学习。这两者的结合对于实现最佳性能至关重要。在这些模型中,首先使用SL对模型进行微调,然后使用RL进一步更新。SL阶段允许模型学习任务的基本结构和内容,而RLHF阶段则完善模型的反应以提高准确性。

标签:CHAChainAINHAIINDEX CHAINChain Wars EssenceblockchainBusiness官网IENETChain

北京时间今天上午7点,备受期待的YugaLabs比特币NFT系列“TwelveFold”正式拍卖.

1900/1/1 0:00:003月8日凌晨,去中心化捐赠平台Gitcoin于官推正式公布了其与指数协议?Index?Coop联合推出的流动性质押指数代币?GitcoinStakedETHIndex的详细信息.

1900/1/1 0:00:00SocialFi市场持续升温,WGFdeSocial完成2000w美元种子轮融资。WGFdeSocial是一个搭建以太坊Layer2网络作为基础设施的社交网络平台,日前完成刚刚完成2000w美元.

1900/1/1 0:00:00头条▌数据:11.9亿美元BTC和4.9亿美元ETH期权合约于17日到期交割3月17日消息,Deribit数据显示,超过11.9亿美元BTC和4.9亿美元ETH的期权合约将于17日到期交割.

1900/1/1 0:00:001.金色观察|创新稳定币项目FraxFinance深入研究在快速发展的去中心化金融世界中,稳定币市场经历了显著的增长,越来越多样化.

1900/1/1 0:00:00内容整理:金色财经2023香港Web3嘉年华将于4月12日至4月15日正式举办,我们不仅能在现场看到Vitalik、赵长鹏等业内大咖的精彩演说,又因参与机构众多,许多活动都是值得期待的.

1900/1/1 0:00:00